Artificial Intelligence dan Bahaya yang Mengintai Anak-anak

'Ledakan' teknologi kecerdasan buatan atau artificial intelligence (AI) tak cuma menyasar remaja hingga orang dewasa. Nyatanya, anak-anak di bawah umur ikut terpapar penggunaan AI, khususnya generative AI.

Adopsi GenAI memang memberi banyak manfaat, mulai dari mencari inspirasi, mempercepat proses riset dan pencarian, atau sekadar teman diskusi. Namun, teknologi ini juga berpotensi memiliki dampak negatif, terutama pada kelompok usia rentan seperti anak-anak.

Seiring pesatnya perkembangan teknologi, akal imitasi sudah menjadi salah satu bagian dari lingkungan digital anak-anak, misalnya, lewat kehadirannya dalam algoritma rekomendasi atau sistem pengambilan keputusan otomatis.

ADVERTISEMENT

SCROLL TO CONTINUE WITH CONTENT

Sementara itu AI generatif juga mulai semakin menguasai pengalaman digital mereka. GenAI kini disematkan sebagai chatbot, asisten digital, asisten pribadi, hingga mesin pencari di dalam perangkat lunak dan aplikasi yang sudah digunakan oleh anak-anak.

Dalam riset yang dilakukan Alan Turing Institute bertajuk Understanding the Impacts of Generative AI Use on Children, paparan tools atau peralatan GenAI terhadap anak terus meningkat.

Survei yang dilakukan lembaga ini menemukan hampir seperempat responden mereka yang berusia 8-12 tahun telah menggunakan teknologi tersebut. Survei ini dilakukan pada 780 anak berusia 8-12 tahun di Inggris.

Hasil survei menunjukkan 22 persen anak-anak menggunakan alat AI generatif, dengan mayoritas (72 persen) melaporkan menggunakannya sebulan sekali atau lebih.

Alat yang paling populer digunakan di kalangan anak-anak adalah ChatGPT, dengan 58 persen yang menggunakan AI generatif melaporkan menggunakan alat ini. Diikuti oleh Gemini sebesar 33 persen, dan My AI by Snapchat sebesar 27 persen.

Hasil riset ini juga menemukan bahwa di antara anak-anak dengan kebutuhan belajar tambahan, tingkat penggunaan ChatGPT secara signifikan lebih tinggi daripada mereka yang tidak memiliki kebutuhan belajar tambahan, yaitu 78 persen dibandingkan dengan 53 persen.

Salah satu dampak negatif yang mungkin terjadi pada anak dari penggunaan GenAI adalah misinformasi. Dengan kapasitas kognitif yang masih dalam tahap berkembang, anak-anak menjadi kelompok yang rentan terhadap masalah ini.

Sebagai contoh, Amazon Alexa menyarankan seorang anak untuk memasukkan koin ke dalam soket listrik. Hal semacam ini tentu bisa membahayakan anak tersebut jika benar-benar dilakukan.

Selain itu, teman AI Snapchat memberikan saran yang tidak pantas kepada wartawan yang menyamar sebagai anak-anak. Snap, pencipta Snapchat, sejak saat itu telah menerapkan alat yang berusaha mendeteksi bahasa yang "tidak sesuai", termasuk referensi untuk kekerasan, istilah-istilah eksplisit secara seksual, penggunaan obat-obatan terlarang, pelecehan seksual anak, perundungan, dan ujaran kebencian.

Namun, banyak sistem AI generatif yang sudah hidup dan dapat diakses oleh anak-anak sambil terus menghasilkan konten atau interaksi yang menyesatkan dan berbahaya.

Terkait konten ilegal, GenAI dapat digunakan untuk membuat materi pelecehan seksual anak yang realistis (CSAM). Model-model generator gambar AI, yang merupakan sumber terbuka dan dengan demikian dapat dioperasikan tanpa pagar pembatas pelindung, dilatih pada CSAM yang ada dan foto-foto anak-anak dari akun media sosial publik.

Meski volume konten semacam itu masih relatif kecil, mengingat betapa cepatnya alat AI generatif berkembang, para peneliti memperkirakan jumlah kasus akan terus bertambah.

Dalam sebuah laporan dari UNICEF berjudul Generative AI: Risks and opportunities for children, GenAI yang menghadirkan chatbot bernada manusia dapat menghilangkan batas antara benda hidup dan benda mati, yang berdampak pada perkembangan anak.

Penelitian menunjukkan bahwa hal tersebut dapat memengaruhi persepsi dan atribusi anak terhadap kecerdasan, perkembangan kognitif, dan perilaku sosial mereka, terutama pada tahap perkembangan yang berbeda.

Singkatnya, dampak negatif GenAI terhadap anak bisa datang dari berbagai aspek, mulai dari yang berkaitan dengan keselamatan dan tumbuh kembang mereka, hingga yang berkaitan dengan data pribadi.

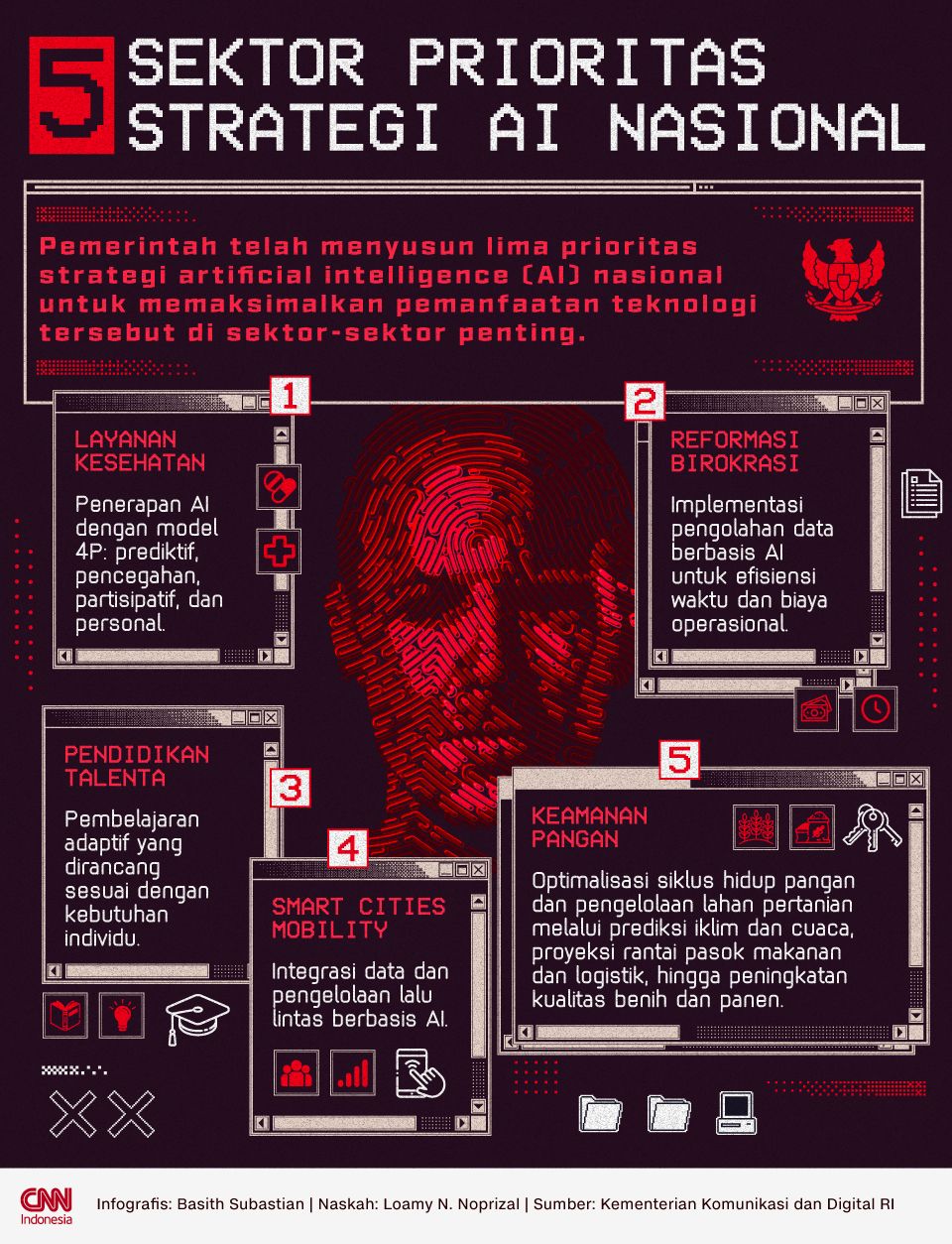

Infografis 5 Sektor Prioritas Strategi AI Nasional (Foto: Basith Subastian/CNNIndonesia) Infografis 5 Sektor Prioritas Strategi AI Nasional (Foto: Basith Subastian/CNNIndonesia) |

Dampak ngeri AI di halaman selanjutnya...

Add as a preferred

as a preferred source on Google